|

Представление информации в двоичной системе счисления. |

1. Подходы к понятию информации и измерению информации.

Понятие информации — одно из фундаментальных в современной науке. «Нет, пожалуй, в науке, практике современности понятия более распространённого, нежели понятие «информация». И нет в тоже время другого понятия, по поводу которого ведётся столько споров, дискуссий, имеется столько различных точек зрения...»,- утверждает советский ученый, академик РАН В.Г. Афанасьев.

Слово «информация» происходит от латинского слова informatio, что в переводе означает сведение, разъяснение, ознакомление. Ещё С.И. Ожегов в «Словаре русского языка» термин «информация» объяснил, как сообщение, осведомляющее о положении дел, состоянии чегонибудь. Федеральный закон «Об информации, информационных технологиях и о защите информации» трактует информацию как «сведения (сообщения, данные) независимо от формы их представления».

Существование множества определений информации обусловлено сложностью, специфичностью и многообразием подходов к толкованию сущности этого понятия. В наибольшей степени понятие информации обязано своим распространением двум научным направлениям: теории связи и кибернетике.

Автор теории связи Клод Шеннон, анализируя технические системы связи (телеграф, телефон, радио) рассматривал их как системы передачи информации. В таких системах информация передается в виде последовательностей сигналов: электрических или электромагнитных.

Основатель кибернетики Норберт Винер анализировал

разнообразные процессы управления в живых организмах и в технических системах.

Процессы управления рассматриваются в кибернетике как информационные процессы.

Информация в системах управления циркулирует в виде сигналов,

передаваемых по информационным каналам.

Основатель кибернетики Норберт Винер анализировал

разнообразные процессы управления в живых организмах и в технических системах.

Процессы управления рассматриваются в кибернетике как информационные процессы.

Информация в системах управления циркулирует в виде сигналов,

передаваемых по информационным каналам.

В ХХ веке понятие информация повсеместно проникает в науку. Нейрофизиология (раздел биологии) изучает

механизмы нервной деятельности животного и человека. Эта наука строит модель информационных процессов, происходящих в организме. Поступающая извне информация превращается в сигналы электрохимической природы, которые от органов чувств передаются по нервным волокнам к нейронам (нервным клеткам) мозга. Мозг передает управляющую информацию в виде сигналов той же природы к мышечным тканям, управляя органами движения. Описанный механизм хорошо согласуется с кибернетической моделью Н. Винера.

В другой биологической науке – генетике используется понятие наследственной информации, заложенной в структуре молекул ДНК, присутствующих в ядрах клеток живых организмов (растений, животных, человека). Генетика доказала, что эта структура является своеобразным кодом, определяющим функционирование всего организма: его рост, развитие, патологии и т.д. Через молекулы ДНК происходит передача наследственной информации от поколения к поколению.

Понятие информации относится к числу фундаментальных, т.е. является основополагающим для науки и не объясняется через другие понятия. В этом смысле информация встает в один ряд с такими фундаментальными научными понятиями, как вещество, энергия, пространство, время. Осмыслением информации как фундаментального понятия занимается наука философия. Согласно одной из философских концепций, информация является свойством всего сущего, всех материальных объектов мира. Такая концепция информации называется атрибутивной (информация – атрибут всех материальных объектов). Информация в мире возникла вместе со Вселенной. С такой широкой точки зрения информация проявляется в воздействии одних объектов на другие.

Другую философскую концепцию информации называют функциональной. Согласно функциональному подходу, информация появилась лишь с возникновением жизни, так как связана с функционированием сложных самоорганизующихся систем, к которым относятся живые организмы и человеческое общество. Можно ещё сказать так: информация – это атрибут, свойственный только живой природе. Это один из существенных признаков, отделяющих в природе живое от неживого.

Третья философская концепция информации – антропоцентрическая, согласно которой информация существует лишь в человеческом сознании, в человеческом восприятии. Информационная деятельность присуща только человеку, происходит в социальных системах. Создавая информационную технику, человек создает инструменты для своей информационной деятельности. Можно сказать, что употребление понятия «информация» в повседневной жизни происходит в антропологическом контексте.

Делая выбор между различными точками зрения, надо помнить, что всякая научная теория – это лишь модель бесконечно сложного мира, поэтому она не может отражать его точно и в полной мере.

2. Типы информации. Свойства

информации.

2. Типы информации. Свойства

информации.

Как и всякий объект,

информация обладает свойствами. Говорить об информации вообще, а не

применительно к какому-то её конкретному виду (роду, типу, классу)

беспредметно. Выделим два типичных класса информации. Первый по способу

восприятия информации. Человек получает информацию о внешнем мире с

помощью своих органов чувств. Как известно, у человека пять органов чувств: зрение,

слух, обоняние, вкус и осязание. Отсюда и пять видов информации: зрительная

(визуальная), слуховая (аудиальная), обонятельная, вкусовая

и осязательная (тактильная).

Как и всякий объект,

информация обладает свойствами. Говорить об информации вообще, а не

применительно к какому-то её конкретному виду (роду, типу, классу)

беспредметно. Выделим два типичных класса информации. Первый по способу

восприятия информации. Человек получает информацию о внешнем мире с

помощью своих органов чувств. Как известно, у человека пять органов чувств: зрение,

слух, обоняние, вкус и осязание. Отсюда и пять видов информации: зрительная

(визуальная), слуховая (аудиальная), обонятельная, вкусовая

и осязательная (тактильная).

Практически около 90% информации человек получает при помощи органов зрения (визуальный), примерно 9% – при помощи органов слуха (аудиальный) и только 1% при помощи остальных органов чувств (обоняния, вкуса, осязания).

По форме

представления информации, информацию можно разделить на следующие виды.

Рассмотрим только те виды информации, которые «понимают» технические

устройства. Компьютер, помогающий человеку хранить и обрабатывать информацию,

приспособлен в первую очередь для обработки текстовой, числовой,

графической информации.

По форме

представления информации, информацию можно разделить на следующие виды.

Рассмотрим только те виды информации, которые «понимают» технические

устройства. Компьютер, помогающий человеку хранить и обрабатывать информацию,

приспособлен в первую очередь для обработки текстовой, числовой,

графической информации.

Текстовая информация, например текст в учебнике, сочинение в тетради, реплика актера в спектакле, прогноз погоды, переданный по радио. Числовая информация, например таблица умножения,

арифметический пример, счёт в хоккейном матче, время прибытия поезда и др. Чаще всего используется комбинированная форма представления

информации. Текстовую и числовую формы информации можно назвать символьной информацией.

Графическая

информация: рисунки, схемы, чертежи, фотографии. Такая форма представления

информации наиболее доступна, так как сразу передает необходимый образ

(модель), а словесная и числовая требуют мысленного воссоздания образа. В то же

время графическая форма представления не дает исчерпывающих разъяснений о

передаваемой информации. Поэтому наиболее эффективно сочетание текста, числа и

графики.

Графическая

информация: рисунки, схемы, чертежи, фотографии. Такая форма представления

информации наиболее доступна, так как сразу передает необходимый образ

(модель), а словесная и числовая требуют мысленного воссоздания образа. В то же

время графическая форма представления не дает исчерпывающих разъяснений о

передаваемой информации. Поэтому наиболее эффективно сочетание текста, числа и

графики.

Звуковая информация: все звуки, которые слышит человек. Они несут информацию об окружающем мире.

В настоящее время мультимедийная (многосредовая, комбинированная) форма представления информации в вычислительной технике становится основной. Цветная графика сочетается в этих системах со звуком и текстом, с движущимися видеоизображением и трехмерными образами.

Информация нам нужна для того, чтобы принимать правильные решения. Рассмотрим свойства информации, т.е. её качественные признаки.

1.

Объективность информации. Информация – это отражение внешнего мира, а он

существует независимо от нашего сознания и желания. Информация

объективна, если она не зависит от чьего-либо мнения, суждения. Пример.

Сообщение «На улице тепло» несёт субъективную информацию, а сообщение «На улице

22°С» - объективную (если термометр исправен). Объективную информацию можно

получить с помощью исправных датчиков, измерительных приборов. Но, отражаясь в

сознании конкретного человека, информация перестает быть объективной, т.к.

преобразовывается (в большей или меньшей степени) в зависимости от мнения,

суждения, опыта, знания конкретного субъекта.

Объективность информации. Информация – это отражение внешнего мира, а он

существует независимо от нашего сознания и желания. Информация

объективна, если она не зависит от чьего-либо мнения, суждения. Пример.

Сообщение «На улице тепло» несёт субъективную информацию, а сообщение «На улице

22°С» - объективную (если термометр исправен). Объективную информацию можно

получить с помощью исправных датчиков, измерительных приборов. Но, отражаясь в

сознании конкретного человека, информация перестает быть объективной, т.к.

преобразовывается (в большей или меньшей степени) в зависимости от мнения,

суждения, опыта, знания конкретного субъекта.

2. Достоверность информации. Информация достоверна, если она отражает истинное положение дел. Объективная информация всегда достоверна,

но достоверная информация может быть как объективной, так и субъективной. Достоверная информация помогает принять нам правильное решение. Недостоверной информация может быть по следующим причинам:

• Преднамеренное искажение (дезинформация);

• Искажение в результате воздействия помех («испорченный телефон»);

• Когда значение реального факта преуменьшается или преувеличивается (слухи, рыбацкие

истории).

3. Полнота (достаточность) информации. Информацию можно назвать полной, если её достаточно для понимания и принятия решения. Например, мечта историка – иметь полную информацию о минувших эпохах. Но историческая информация никогда не бывает полной, и полнота информации уменьшается по мере удаленности от нас исторической эпохи. Даже события происходившие на наших глазах, не полностью документируются, многое забывается, и воспоминания подвергаются искажению. Неполная информация может привести к ошибочному выводу или решению.

4. Актуальность (своевременность) информации – важность, существенность для настоящего времени. Только вовремя полученная информация может принести необходимую пользу. Неактуальной информация может быть по двум причинам: она может быть устаревшей (прошлогодняя газета) либо незначимой, ненужной (например, сообщение о том, что в Италии снижены цены на 5%).

5. Полезность или бесполезность (ценность) информации. Так как границы между этими понятиями нет, то следует говорить о степени полезности применительно к нуждам конкретных людей. Полезность информации оценивается по тем задачам, которые мы можем решить с её помощью. Самая ценная для нас информация – достаточно полезная, полная, объективная, достоверная и новая.

6. Понятность (доступность) информации. Информация понятна, если она выражена на

языке, доступном для получателя.

3. Измерение информации.

Какое количество информации содержится, к примеру, в тексте романа «Война и мир», в картинах Рафаэля или в генетическом коде человека? Ответа на эти вопросы наука не даёт и, по всей вероятности, даст не скоро.

А возможно ли объективно измерить количество информации? Важнейшим результатом теории информации является следующий вывод: в определённых, весьма широких условиях можно пренебречь качественными особенностями информации, выразить её количество числом, а также сравнить количество информации, содержащейся в различных группах данных.

В настоящее время получили распространение два подхода к определению понятия «количество информации»: вероятностный (чаще используется в теории информации) и объёмный (чаще используется в вычислительно технике). Вероятностный подход называют ещё содержательным, а объёмный – алфавитным.

Вероятностный (содержательный) подход.

Вероятностный подход предложил один из основоположников кибернетики американский математик Клод Шеннон. Чтобы измерить количество информации, нужно выбрать какую-то единицу, эталон. В качестве такого эталона принимают информацию, при выборе одного из двух вариантов. Согласно Шеннону, информация – это снятая неопределённость знания человека об исходе какого-то события.

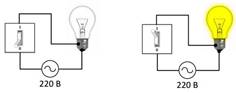

Например,

электрическая лампочка может находиться в двух состояниях: «горит» и «не

горит». Тогда на вопрос «Горит ли сейчас лампочка?» есть два возможных варианта

ответа, которые можно обозначить цифрами: 1 (горит) и 0 (не

горит), тогда можно записать ответ как 0 или 1. Цифры 0 и 1 называются

двоичными.

Например,

электрическая лампочка может находиться в двух состояниях: «горит» и «не

горит». Тогда на вопрос «Горит ли сейчас лампочка?» есть два возможных варианта

ответа, которые можно обозначить цифрами: 1 (горит) и 0 (не

горит), тогда можно записать ответ как 0 или 1. Цифры 0 и 1 называются

двоичными.

В качестве единицы информации Клод Шеннон предложил принять один бит (англ. bit— binary digit— двоичная цифра).

![]() Бит— это

количество информации, соответствующее выбору одного из двух равновозможных

(равновероятных) событий.

Бит— это

количество информации, соответствующее выбору одного из двух равновозможных

(равновероятных) событий.

Сообщение, уменьшающее неопределенность знаний человека в 2 раза, несёт для него 1 бит информации.

Количество информации, заключённое в сообщении, определяется по формуле Хартли: 𝑵 = 𝟐𝒊,

где N – количество вариантов исхода или неопределённость знания, i – количество информации, которое несёт сообщение.

Следствие: i= log2N

Пример 1: Действительно ли сообщение об исходе опыта бросания монеты содержит количество информации, равное одному биту.

Решение: Так как возможных вариантов исхода N при бросании монеты – два («орёл» - «решка»).

Значит, 2 = 2i. Следовательно, i= 1.

Ответ: Количество информации=1 бит.

Пример 2: Какое количество информации содержит сообщение об исходе опыта бросания двух монет?

Решение: Подсчитаем количество равновозможных исходов: орёл-решка; решка-орёл; орёл-орёл;

решка-решка, т.е. четыре. Значит, N=4. Получим: 4=2i. Отсюда, i=2.

Ответ: Количество информации=2 бита.

Объёмный (алфавитный) подход.

Алфавитный подход основан на том, что всякое сообщение

можно закодировать с помощью конечной последовательности символов некоторого

алфавита. Носителями информации являются любые последовательности символов,

которые хранятся, передаются и обрабатываются с помощью компьютера. Алфавитный

(объёмный) подход применяется в технике. Этот подход основан на подсчёте числа

символов в сообщении, то есть связан только с длиной сообщения и не учитывает

его содержания. При этом учитывается, так называемая, мощность алфавита –

полное количество символов в алфавите (с учётом пробела, точки, запятой,

тире, вопросительного и восклицательного знаков). Например, мощность русского

алфавита складываемая из

Алфавитный подход основан на том, что всякое сообщение

можно закодировать с помощью конечной последовательности символов некоторого

алфавита. Носителями информации являются любые последовательности символов,

которые хранятся, передаются и обрабатываются с помощью компьютера. Алфавитный

(объёмный) подход применяется в технике. Этот подход основан на подсчёте числа

символов в сообщении, то есть связан только с длиной сообщения и не учитывает

его содержания. При этом учитывается, так называемая, мощность алфавита –

полное количество символов в алфавите (с учётом пробела, точки, запятой,

тире, вопросительного и восклицательного знаков). Например, мощность русского

алфавита складываемая из

количества букв и перечисленных символов, равна: N =33+6=39.

В вычислительной технике битом называют наименьшую «порцию» памяти компьютера, необходимую для хранения одного из двух знаков: "0" или"1", используемых для внутримашинного представления данных и команд.

Для того чтобы закодировать алфавит из N символов, нужно взять i–разрядный код, определяемый из формулы:

Пример 3: Посчитать количество разрядов двоичного кода, необходимых для кодирования алфавита русского языка.

Решение: Так как мощность алфавита русского языка N=39, то 39 = 2i. Так как, 25=32, 32<39, то ближайшая к 39 целая степень двойки: 39 < 26=64. Оставшийся резерв можно использовать для кодирования цифр, всевозможных математических знаков, скобок и т.п.

Следовательно, i= 6.

Ответ: Количество двоичных разрядов для кодирования символов русского алфавита равно 6.

![]() Длина

i двоичного кода, с помощью которого кодируется символ

алфавита, называется информационным весом символа.

Длина

i двоичного кода, с помощью которого кодируется символ

алфавита, называется информационным весом символа.

Если - информационный вес символа алфавита, а – количество символов в тексте, записанном с помощью этого алфавита, то информационный объём текста выражается формулой: 𝐼 = 𝐾 ∙ 𝑖 (бит)

Так текст, состоящий из 1000 символов русского алфавита с мощностью N=39, равен

I = 1000 ∙6=6000 бит. Определите информационный вес символа алфавита, включающего в себя все строчные и прописные русские буквы (66), цифры (10), знаки препинания, скобки, кавычки

(10).

Бит слишком мелкая единица измерения. На практике чаще применяется более крупная единица— байт, равная восьми битам.

Например, именно восемь бит требуется для того, чтобы закодировать любой из 256 символов алфавита клавиатуры компьютера (256=28). Информационный объём текста в памяти компьютера измеряется в байтах и равен количеству символов в записи текста.

Помимо бита и байта, для измерения информации используются и более крупные единицы:

|

1 Кб (килобайт) = |

210 байт = |

1024 байт |

|

|

1 Мб (мегабайт) = |

210 Кб = |

1024 Кб |

|

|

1 Гб (гигабайт) = |

210 Мб = |

1024 Мб |

|

|

1 Тб (терабайт) = |

210 Гб = |

1024 Гб |

|

4. Представление информации в двоичной системе счисления. Универсальность дискретного (цифрового) представления информации.

Мы уже с вами говорили, что компьютер может хранить и обрабатывать данные, представляющие информацию четырёх видов: числовую, текстовую, графическую и звуковую. Вне зависимости от вида информация в компьютере хранится, обрабатывается в виде двоичных кодов. В этом состоит универсальность представления информации. Также можно сказать, что представление данных в компьютере дискретно (от лат discretus — разделённый, прерывистый — свойство, противопоставляемое непрерывности).

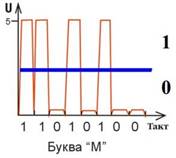

Кодирование и

передача информации в компьютере осуществляется с помощью электрических

сигналов. Обработка этих сигналов происходит в микросхемах. Уровню напряжения

от 0 до 0,5 В (Вольт) условно поставлена в соответствие цифра 0, а

уровню напряжения от 2,5 до 5 В – цифра 1. Информация, закодированная в

виде двоичного кода, может быть представлена в виде цепочки электрических

импульсов – кодом из восьми нулей и единиц. Например, на картинке изображён код

буквы М – 11010100. Двоичную систему удобно использовать в

компьютере, так как существующие технические устройства могут надёжно сохранять

и распознавать два различных состояния: есть ток в элементе – 1, нет

тока – 0.

Кодирование и

передача информации в компьютере осуществляется с помощью электрических

сигналов. Обработка этих сигналов происходит в микросхемах. Уровню напряжения

от 0 до 0,5 В (Вольт) условно поставлена в соответствие цифра 0, а

уровню напряжения от 2,5 до 5 В – цифра 1. Информация, закодированная в

виде двоичного кода, может быть представлена в виде цепочки электрических

импульсов – кодом из восьми нулей и единиц. Например, на картинке изображён код

буквы М – 11010100. Двоичную систему удобно использовать в

компьютере, так как существующие технические устройства могут надёжно сохранять

и распознавать два различных состояния: есть ток в элементе – 1, нет

тока – 0.

Такое дискретное представление информации в виде двоичных кодов называют ещё цифровым.

Контрольные вопросы:

1. Какие направления в науке способствовали распространению понятия «информация»? В чём суть этих направлений? Кто автор?

2. Объясните понятие «информация» с точки зрения нейрофизиологии, генетики.

3. Что представляет собой информация с точки зрения философии? Назовите сущность трёх философских концепций информации.

4. Назовите классификацию информации по способу восприятия и по форме представления.

5. Перечислите свойства информации и приведите примеры, поясняющие суть этих свойств?

6. Какие подходы к измерению информации существуют? В чём суть вероятностного (содержательного) подхода к измерению информации? алфавитного (объёмного)?

7. Что значит название БИТ? В чём разность определений 1 бит информации в вероятностном и алфавитном подходах?

8. Решите задачу: Определите информационный вес символа алфавита, включающего в себя все строчные и прописные русские буквы (66), цифры (10), знаки препинания, скобки, кавычки (10).

9. Определите сколько в 1 Гб содержится байт? В 1 Тб – Мб? В 1 Тб – Кб? В 1 Тб – б?

10. В чём состоит универсальность дискретного представления информации? Что значит дискретный?

11. Почему удобно использовать цифровое представление информации в компьютере?

Используемые источники:

1. Семакин И.Г. Информатика. Базовый уровень: учебник для 10 класса / И.Г. Семакин, Е.К. Хеннер, Т.Ю. Шеина.-3-е изд. – М.: БИНОМ. Лаборатория знаний, 2014

2. Семакин И.Г. Информатика. Углублённый уровень: учебник для 10 класса: в 2 ч. Ч. 2 / И.Г. Семакин, Е.К., Т.Ю. Шеина, Л.В. Шестакова.-3-е изд. – М.: БИНОМ. Лаборатория знаний, 2014

3. Поляков К.Ю., Шестаков А.П., Еремин Е.А. Информатика и ИКТ. 10 класс: профильный уровень - Учебник. — М.: Сети, 2011. — 274 с.

4. http://www.aselibrary.ru/digital_resources/journal/irr/2007/number_3/number_3_6/number_3_6571 -

«ИНФОРМАЦИОННЫЕ РЕСУРСЫ РОССИИ» №3, 2007. - Об определении понятия «информация»,

В. Хургин

Материалы на данной страницы взяты из открытых источников либо размещены пользователем в соответствии с договором-офертой сайта. Вы можете сообщить о нарушении.